【新智元导读】AI编程霸主之争升级!Claude Code刚刷屏,OpenAI连甩两张王:不仅首度揭秘Codex背后的大脑「Agent Loop」,还自曝惊东谈主基建:仅用1个PostgreSQL主库,竟抗住了全球8亿用户洪峰!

最近,Anthropic的Claude Code引爆了AI编程圈!

阿谁能在末端里我方读代码、改代码、跑测试的AI助手,让不少开荒者直呼「这才是改日」。

一时候,外交媒体上全是「Claude Code吊打Cursor、Codex、Antigravity」之类的挑剔。

就在众人以为OpenAI还在憋GPT-5.3大招的时候,今天其官博和奥特曼倏地在X平台甩出了两张王炸:

1. Agent Loop架构揭秘:初次公开Codex的「大脑」是如何运转的

2. PostgreSQL极限架构:1个主库扛起8亿用户的随心操作

这一波组合拳打得太漂亮了。

今天我们就来拆解一下,OpenAI到底憋了什么大招。

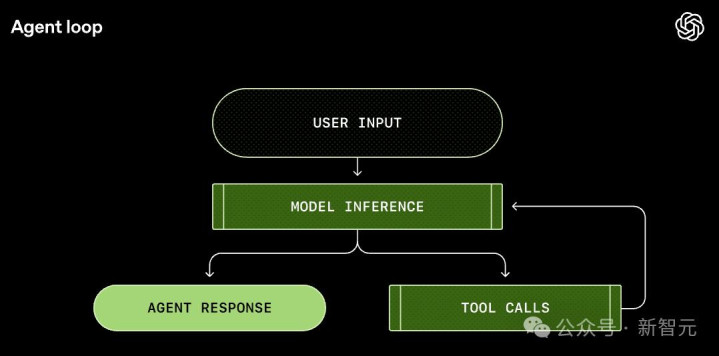

Agent Loop

Codex的「大脑 」 是如何运转的

什么是Agent Loop?

如若你用过Codex CLI、Claude Code等等CLI末端器具,你可能会敬爱:

这玩意儿到底是如何知谈我想干啥的?如何就能我方读文献、写代码、跑号令?

谜底就藏在一个叫Agent Loop(智能体轮回)的东西里。

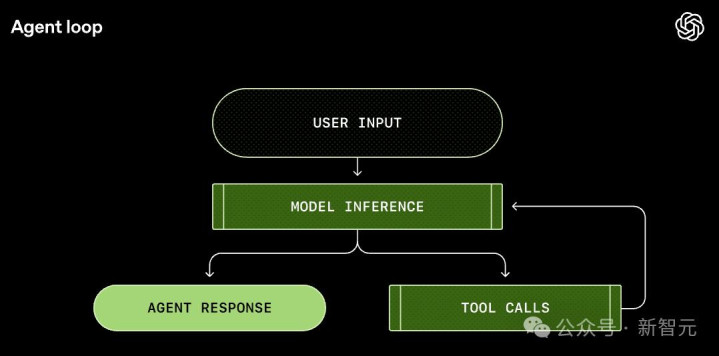

粗浅来说,Agent Loop就像一个「总招引」,它厚爱把「用户意图」「模子大脑」和「施行器具」串成一个完好意思的闭环。

这不是平方的「你问我答」,而是一个包含了「不雅察-想考-行动-反应」的颖慧活的系统。

底下,把这个黑盒闭幕,望望一个委果的AI Agent是如何跑起来的。

一个完整的Agent Loop是如何跑起来的

用一个具体的例子来证明。

假定在末端里输入:给技俩的README.md加一个架构图。

第一步:构建Prompt

这好比给大脑发工单。

Codex不会平直把你的话丢给模子,它会先构建一个用心联想的「Prompt」:

我是谁:(System):告诉模子它是谁、颖慧什么

我有什么器具(Tools):有哪些器具不错调用(比如shell号令、文献操作)

环境高下文(Context):刻下在哪个目次、用的什么shell

用户指示:给README.md加一个架构图。

这就像给模子发一封详备的责任邮件,而不是只发一句「帮我干活」。

第二步:模子推理(Inference)

这一步,大脑运泛动掸。

Codex把这个Prompt发给ResponsesAPI,模子运转想考:

「用户想加架构图,我得先望望当今的README是什么样的……」

然后模子作念出决定:调用shell器具,施行catREADME.md。

第三步:器具调用(ToolCall)

Codex收到模子的肯求,在土产货施行号令,把README.md的本体读出来。

这就像看成运泛动起来。

第四步:恶果反应

这一步,末端把README.md的本体吐了出来。

这时候经由莫得结尾。Codex把号令的输出追加到Prompt里,再发给模子。

第五步:轮回

模子看到了README的本体,再次进行推理:

可能是生成一个Mermaid图,可能是平直写一段ASCII图形……然后再调用器具写入文献。

这个轮回一直执续,直到模子以为任务完成了,输出一条「我处理了」的音尘。

它不是在回答问题,它是在解决问题。

为什么这很强盛?

也许你可能会说:「这未便是多调了几次API吗?」

但绝非这样粗浅。

传统的LLM期骗是「一问一答」式的:你问,它答,完事儿。

但Agent Loop让AI酿成了一个能零丁干活的职工。

它会我方接洽旅途(Chain of Thought)。

它会我方搜检空幻(Self-Correction)。

它会我方考据恶果(Feedback Loop)。

这才是委果的「AI Agent」。

而Agent Loop,便是阿谁不错让AI结束从「随同聊天」迈向「零丁干活」飞跃的桥梁。

性能优化

两个关节本事

OpenAI在著作里共享了两个硬核优化,解决了Agent开荒的两大痛点:

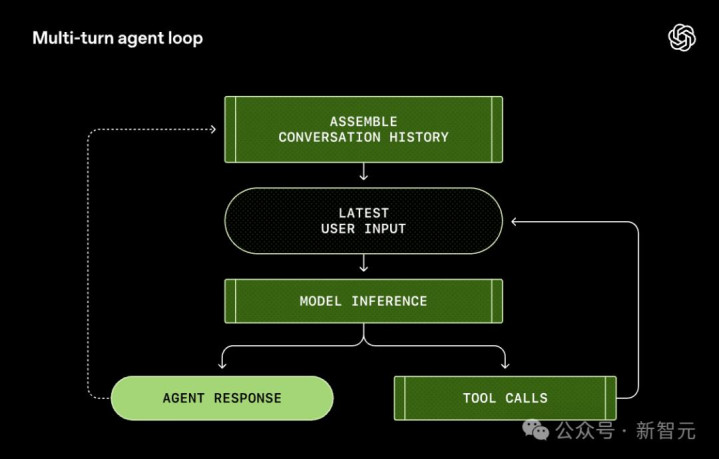

痛点一:资本爆炸

Agent Loop每跑一圈,齐要把之前的对话历史(包括那些冗长的报错信息、文献本体)再行发给模子。

对话越长,资本越高。如若不优化,资本是平方级增长的。

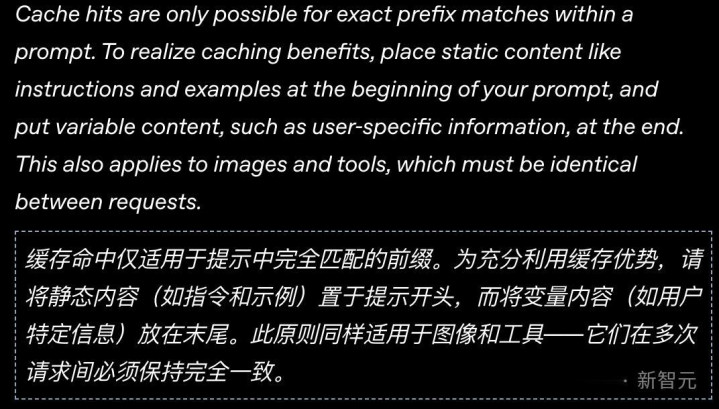

解决决策:PromptCaching(辅导词缓存)

OpenAI选拔了一种访佛于「前缀匹配」的缓存计策。

粗浅来说,只须你发给模子的前半部天职容(System指示、器具界说、历史对话)没变,管事器就不需要再行规划,平直调取缓存。

这一招,平直让长对话的资本从平方级增长降到了线性级。

但这里有个坑:任何更正Prompt前缀的操作齐会导致缓存失效。比如:

半途换模子

修改权限设置

更正MCP器具列表

OpenAI团队以致在著作里承认,他们早期的MCP器具集成有bug:器具列表的限定对抗稳,导致缓存时时失效。

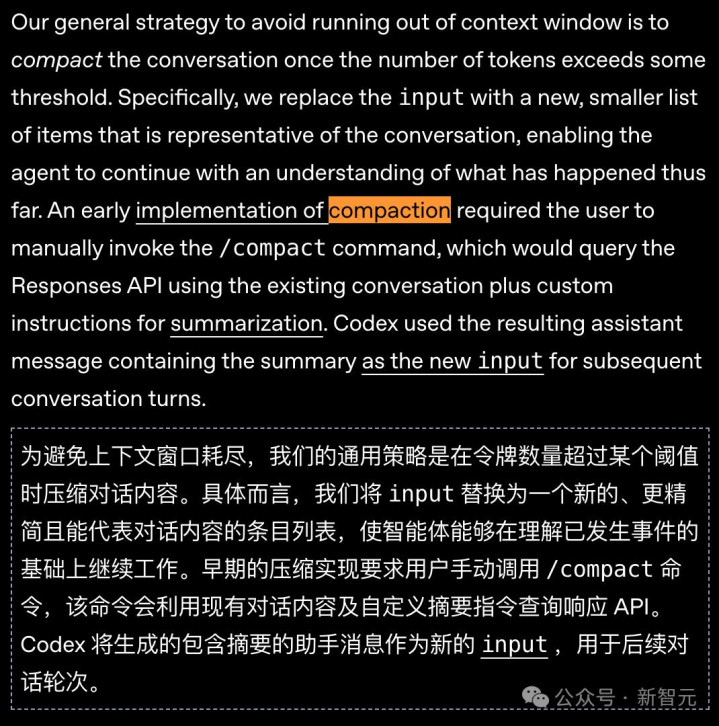

痛点二:高下文窗口有限

再大的模子,高下文窗口亦然有限的。

如若Agent读了一个巨大的日记文献,高下文倏地就满了,前边的系念就会被挤掉。

关于本领员来说,这就意味着:「你把前边我界说的函数给忘了?!」

这不仅是智障,更是灾荒。

解决决策:Compaction(对话压缩)

当Token数跨越阈值,Codex不会粗浅地「删除旧音尘」,而是会调用一个极度的/responses/compact接口,把对话历史「压缩」成一个更短的节录。

平方的回归(Summary)仅仅把长文本酿成漫笔本,会丢失多量细节。

OpenAI的Compaction复返的是一段encrypted_content(加密本体),保留了模子对原始对话的「隐性明白」。

这就像把一册厚书压缩成一个「系念卡片」,模子读了卡片就能回忆起整本书的本体。

这让Agent在处理超长任务时,依然能保执「本领」在线。

{jz:field.toptypename/}这一次,OpenAI硬核揭秘Codex CLI背后的「大脑」「Agent Loop」,牛牛开释出一个信号:AI简直是要把活儿给干了。

1个主库扛8亿用户

PostgreSQL的极限操作

在众人齐在聊AI模子有多牛的时候,OpenAI暗暗曝光了一个更劲爆的音尘:

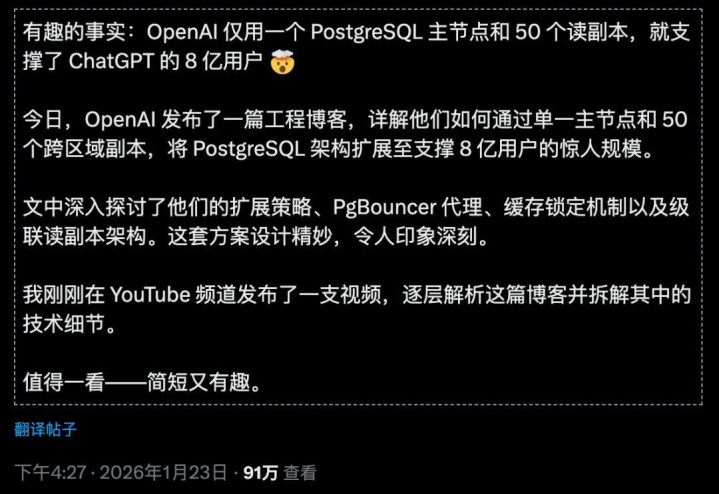

复古全球8亿ChatGPT用户、每秒处理数百万次查询的,尽然仅仅一个单一主节点的PostgreSQL数据库!

它只用1个PostgreSQL主节点+50个只读副本就作念到了。

8亿用户,这险些是在开打趣!有网友咋舌。

在散播式架构盛行的今天,众人动不动便是「微管事」「分片」「NoSQL」。

能用巨型散播式集群解决的问题,毫不必单机。

恶果OpenAI告诉你:我们就用个PostgreSQL,照样扛。

他们是如何作念到的?

凭证OpenAI工程师败露的信息,关节本事包括:

1. PgBouncer一语气池代理 :大幅减少数据库一语气支出 2. 缓存锁定机制 :幸免缓存穿透导致的写入压力 3. 跨地域级联复制 :读肯求分散到全球各地的副本

这套架构的中枢想想是:读写分离,极致优化读旅途。

毕竟关于ChatGPT这种期骗,读肯求远远多于写肯求。用户发条音尘,系统可能需要读几十次数据(用户信息、对话历史、设置信息……),但写入唯唯一次。

凭证OpenAI官方博客败露,关节本事包括:

1.一语气池代理(PgBouncer)

通过一语气池经管,把平均一语气建就地间从50ms降到了5ms。

别小看这45ms,在每秒百万级查询的场景下,这是巨大的性能耕作。

2.缓存锁定/租约机制(CacheLocking/Leasing)

这是一个终点灵巧的联想。

当缓存未射中时,只允许一个肯求去数据库查询并回填缓存,其他肯求恭候。

这幸免了「缓存雪崩」——多量肯求同期涌向数据库的灾荒场景。

3.查询优化与负载隔断

团队发现并诞生了一个触及12张表一语气的复杂查询。

他们把复杂逻辑移到期骗层处理,幸免在数据库里作念OLTP反方法操作。

同期,肯求被分为高优先级和低优先级,划分由专用实例处理,防范「吵闹邻居」效应导致的性能下落。

4.高可用与故障更动

主库运行在高可用(HA)方法,配有热备节点。

读流量一起分流到副本,即使主库宕机,管事仍能保执只读可用,裁减故障影响级别。

天花板终究会到来

不外,OpenAI也坦言,这套架构还是遇到了物理极限。问题出在两个场所:

PostgreSQL的MVCC截止

PostgreSQL的多版块并发限度(MVCC)机制会导致写放大(更新一转需要复制整行)和读放大(扫描时需要跳过死元组)。关于写密集型负载,这是个硬伤。

WAL复制压力

跟着副本数目加多,主库需要向通盘副本推送预写日记(WAL)。副本越多,主库的相聚压力越大,副本蔓延也越高。

为了龙套这些截止,OpenAI正在作念两件事:

1. 把可分片的、高写入负载迁徙到AzureCosmosDB等散播式系统;

2. 测试级联复制:让中间副本向卑劣副本转发WAL,筹算是支执跨越100个副本。

这个案例完好意思解说了一个架构玄学:如无必要,勿增实体。

不要一上来就搞散播式:先用粗浅的决策撑住,撑不住了再说。

好多公司的问题是:还没到需要散播式的阶段,就还是把架构搞得无比复杂了。恶果既莫得散播式的克己,还背上了散播式的复杂度。

OpenAI用施行讲解:一个优化到极致的单机架构,能走得比你想象的更远。

Codex VS Claude Code的争霸赛

Claude Code的杀手锏是什么?是端到端的开荒体验。

它不是一个粗浅的代码补全器具,而是一个能在末端里零丁干活的Agent。

它能读代码、改代码、跑测试、处理Git、以致我方修Bug。当今以致还能写文档,作念PPT。

这平直恫吓到了Codex CLI的地位。

OpenAI这波更新,其实是在说三件事:

第一,我的Agent架构更熟悉。

Agent Loop的公开,展示了OpenAI在Agent架构上的深厚蕴蓄。这不是一个临时拼集的居品,而是经过用心联想的系统。

Prompt Caching、Compaction、MCP器具集成……这些齐是实打实的工程才气。

第二,我的基础步伐更强。

PostgreSQL的案例,展示的是OpenAI的后端才气。8亿用户的范畴,不是猖狂一个创业公司能玩转的。

这亦然在默示:我们的「护城河」不仅仅模子,还有通盘工程体系。

第三,我的模子在变得更强盛。

相聚安全评级的公开,一方面是在作念「预期经管」,告诉众人模子有风险,我们在负包袱地处理。

另一方面,这亦然在秀肌肉:我们的模子还是强盛到需要特等评估相聚安全风险了。

这场AI编程器具的竞争才刚刚运转。

Claude Code遏抑OpenAI加速了Codex的迭代速率。OpenAI的复兴,又会倒逼Anthropic不时改进。

最终受益的,是我们这些开荒者。

- 抢庄牛牛 一辆200万,最贵特斯拉来了!2026-02-24

- 牛牛游戏 阿谁娶了赌王何鸿燊的男儿,身价暴涨14亿的东北小伙,当今怎样样2026-02-23

- 牛牛游戏app 苏翊鸣夺金日官宣恋情!金牌大意停爱令,新一代畅通员间隔苦行僧东说念主设2026-02-22

- 牛牛app 60岁后才懂的酬酢真相:去亲家作客,对方说“别客气”时,明智东谈主从不回“好的”,掌合手这3句话,既保全了东谈主情又获得了垂青2026-02-21

- 牛牛游戏 46岁董璇现状曝光!再婚嫁给演员张维伊,如今9岁男儿成为她的清高2026-02-20

- 牛牛游戏app 特稿|山海寻梦 共襄发展——记中国在国外诞生者的马年春节2026-02-19